2024年6月5日,云基智能机器人实验室针对视觉问答的最新研究成果”Question Type-Aware Debiasing for Test-time Visual Question Answering Model Adaptation”在期刊《IEEE Transactions on Circuits and Systems for Video Technology》在线发表,该期刊是电子与电气领域TOP期刊,中科院一区,影响因子为8.3。

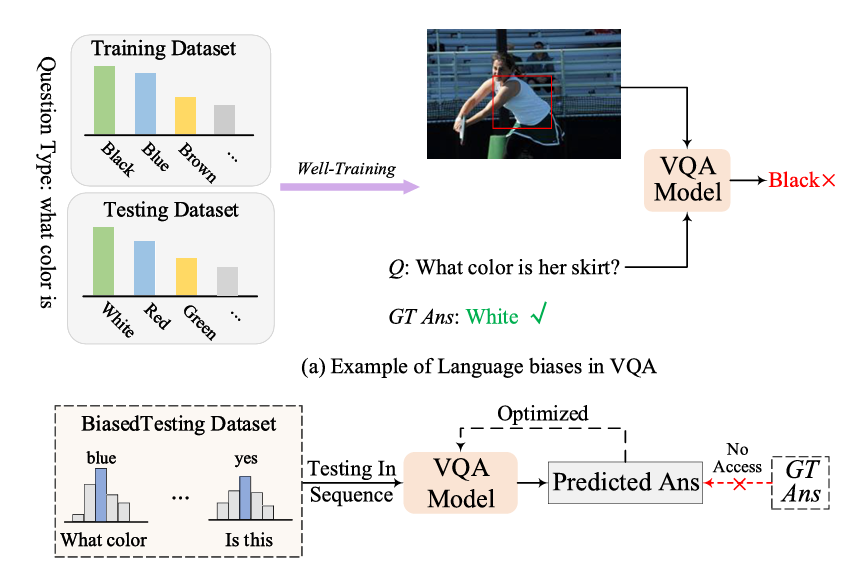

在视觉问答 (VQA) 中,解决语言先验偏差至关重要,其中模型过度依赖问题和答案之间的表面相关性。在测试期间,此问题在具有不同域和不同问答分布的实际应用程序中变得更加明显。为了应对这一挑战,测试时适应 (TTA) 应运而生,允许预先训练的 VQA 模型使用未标记的测试样本进行调整。当前最先进的模型根据固定熵阈值选择可靠的测试样本,并采用自监督去偏差技术。然而,这些方法在与不同问题类型相关的不同答案空间中挣扎,并且可能无法识别仍然利用相关视觉上下文的有偏见的样本。在本文中,我们提出了问题类型引导的熵最小化和去偏差 (QED) 作为测试时 VQA 模型适应的解决方案。我们的方法涉及基于问题类型的自适应熵最小化,以改进对细粒度和不可靠样本的识别。此外,我们为每个测试样本生成负样本,如果它们的答案熵变化率与正样本明显不同,则将其标记为有偏差,然后将其删除。我们根据 VQA-CP v2 和 VQA-CP v1 两个公共基准评估我们的方法,并取得了最先进的新结果,总体准确率分别为 48.13% 和 46.18%。